Paris met en place l’Inesia, un institut public de surveillance de l’intelligence artificielle

A quelques jours de l’entrée en vigueur du règlement européen sur l’intelligence artificielle (IA Act) et de la tenue du Sommet pour l’action sur l’IA à Paris, la France a créé vendredi 31 janvier 2025 un institut public de surveillance de cette technologie, baptisé Inesia. La principale mission de cet organisme, piloté par le secrétariat général de la Défense et de la Sécurité nationale (SGDSN), est “l’anticipation des possibles risques inhérents” à l’IA, à l’heure où les superpuissances comme les États-Unis et la Chine multiplient les investissements et se dotent de leurs outils. Selon le communiqué du gouvernement, l’Inesia “ne sera pas doté des pouvoirs d'un régulateur”. Néanmoins, l’expertise peut ainsi se retrouver concentrée entre des mains étatiques.

Pas de régulation

“Cet institut a pour mission de fédérer, sans création de nouvelle structure juridique, les acteurs nationaux de l’évaluation et de la sécurité, au premier rang desquels l’Agence nationale de la sécurité des systèmes d'information (ANSSI), l’Institut national de recherche en sciences et technologies du numérique (Inria), le Laboratoire National de Métrologie et d’Essais (LNE) et le Pôle d’expertise de la régulation numérique (PEReN)”, explique le gouvernement vendredi.

L’Inesia est lui-même piloté par plusieurs institutions, le SGDSN à leur tête, simultanément avec la Direction générale des Entreprises (DGE) du ministère de l’Économie, des Finances et de la Souveraineté industrielle et numérique.

“Sans créer de nouvelle structure juridique” qui pourrait lui permettre de jouer le rôle de régulateur, Paris met en place cet institut “conformément aux priorités établies en mai 2024 par la Déclaration de Séoul”, signée par dix pays et l'Union européenne, pour “étudier scientifiquement l'ensemble des effets de cette technologie, y compris en termes de sécurité”. L’État, explique encore le gouvernement, “matérialise son engagement en faveur d’un développement maîtrisé de l’IA dans un cadre de confiance et de sécurité”.

Le timing n’est pas anodin. La mise en place de l’Inesia s'inscrit dans une dynamique française et européenne plus large de régulation et de surveillance de l'IA. La création de l’institut est annoncée deux jours avant l’entrée en vigueur, hier dimanche, du règlement européen sur l’intelligence artificielle (AI Act), qui suscite d’ailleurs des critiques pour les restrictions imposées.

Des PME et des start-ups craignent d'être désavantagées par les lourdes obligations de conformité, qui pourraient favoriser les géants technologiques étrangers, américains ou encore chinois. En outre, la centralisation de la surveillance, entre les mains des autorités publiques essentiellement, soulève des questions liées à la transparence, notamment dans la gestion des données et la correction des biais algorithmiques.

L’accent mis sur le contrôle

L’Inesia voit aussi le jour quelques jours avant la tenue du Sommet pour l’action sur l’intelligence artificielle (IA) organisé les 10 et 11 février à Paris. La France emboîte le pas au Royaume-Uni, qui a organisé un sommet similaire fin 2023, et accueillera 100 chefs d’État et quelques 600 dirigeants d’entreprises et d’ONG.

Le sommet de Londres se concentrait déjà sur la sécurité et les risques de l’IA et la mouture de Paris, l’IA Action Summit, tout en se voulant plus optimiste et positive, insistera à son tour sur cet aspect-là. “Nous allons mettre en évidence les risques de l’IA, déjà bien évoqués à Londres, en novembre 2023 et à Séoul en mai, mais aussi les opportunités et les bénéfices de cette technologie”, expliquait l’Elysée.

En théorie, la régulation de l’IA devrait profiter aux consommateurs et citoyens en garantissant une utilisation plus éthique et responsable de cette technologie, à l’aide de systèmes transparents et non discriminatoires. Économiquement, des textes comme l’AI Act pourraient aussi profiter aux géants technologiques étrangers par leur capacité à se conformer rapidement aux normes, au détriment des entreprises moins puissantes.

Mais une centralisation de la surveillance et la régulation de l’IA renforce surtout le contrôle des autorités publiques sur les données et les systèmes d'IA. Cela peut leur permettre de mieux gérer théoriquement les risques associés à l'IA. Mais cela soulève également des questions sur la concentration du pouvoir et la protection des droits individuels.

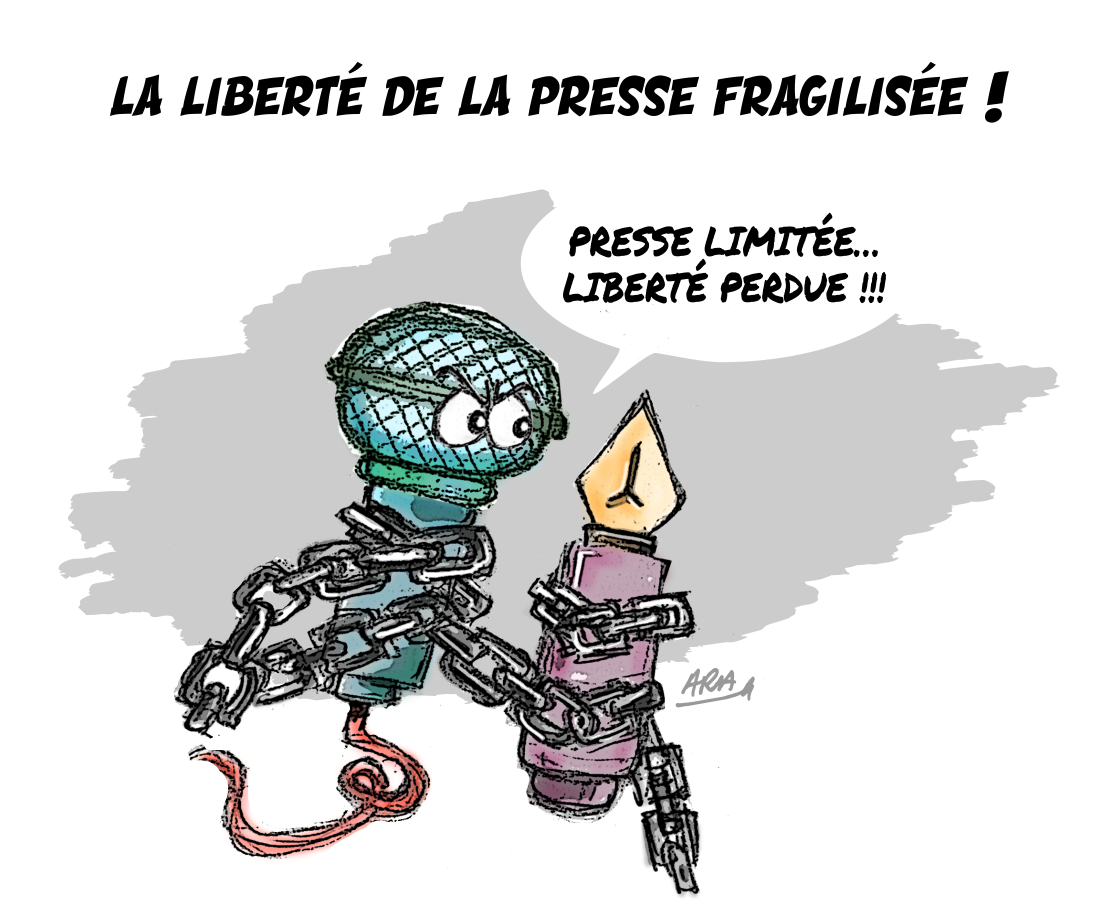

L'article vous a plu ? Il a mobilisé notre rédaction qui ne vit que de vos dons.

L'information a un coût, d'autant plus que la concurrence des rédactions subventionnées impose un surcroît de rigueur et de professionnalisme.

Avec votre soutien, France-Soir continuera à proposer ses articles gratuitement car nous pensons que tout le monde doit avoir accès à une information libre et indépendante pour se forger sa propre opinion.

Vous êtes la condition sine qua non à notre existence, soutenez-nous pour que France-Soir demeure le média français qui fait s’exprimer les plus légitimes.

Si vous le pouvez, soutenez-nous mensuellement, à partir de seulement 1€. Votre impact en faveur d’une presse libre n’en sera que plus fort. Merci.